人工智能。 第一部分:超级智能的途径

这个(和其他)文章产生的原因很简单:也许人工智能不仅是讨论的重要话题,而且是未来背景下最重要的话题。 所有那些至少了解人工智能潜力的人,都认识到不可能忽视这个话题。 一些人 - 包括伊隆马斯克,斯蒂芬霍金,比尔盖茨,不是我们这个星球上最愚蠢的人 - 相信人工智能代表着对人类的生存威胁,其规模可与我们作为一个物种完全灭绝相提并论。 好吧,坐下来把所有的点都放在我身上。

“我们正处于变革的边缘,与地球上人类生命的诞生相当”(Vernor Vinge)。

站在这些变化的门槛上意味着什么?

这似乎没什么特别的。 但是你必须记住,在这样一个地方的图表上意味着你不知道你右边的是什么。 你应该这样:

感觉很正常,飞行成功。

未来即将到来

想象一下,一台时光机将您带到了1750年-当时世界上电力供应不断中断,城市之间的联系暗示着加农炮的射击,而所有运输工具都是干草。 假设您到达那里,带一个人进入2015年,以展示这里的情况。 我们无法理解他看到所有闪亮的胶囊在马路上飞来飞去的感觉。 与大洋彼岸的人们交谈; 看一千公里外的体育比赛; 聆听50年前录制的音乐表演; 玩一个可以拍摄照片或捕捉现场瞬间的魔术矩形; 用超自然的蓝色圆点表示其位置的地图; 看着某人的脸,并与他沟通很多公里等等。 对于几乎三百岁的人们来说,所有这一切都是莫名其妙的魔法。 更不用说互联网,国际空间站,大型强子对撞机,核能 武器装备 和相对论。

对他来说这样的经历不会令人感到意外或震惊 - 这些话并没有传达出精神崩溃的本质。 我们的旅行者甚至可能会死

但有一个有趣的观点。 如果他回到1750年并且他变得嫉妒我们想看看他对2015年的反应,他可以和他一起拿一台时间机器并尝试做同样的事情,比如1500年。 到达那里,找一个人,在1750中获得一年并展示一切。 来自1500的那一年,这一年将会非常震惊 - 但不太可能会死。 虽然他肯定会感到惊讶,但1500和1750之间的差异远小于1750和2015之间的差异。 来自1500的一名男子将在物理学的某些时刻感到惊讶,对于欧洲在帝国主义的艰难五分之一下的成就感到惊讶,将在他的头脑中画出一幅新的世界地图。 但1750的日常生活 - 交通,通讯等 - 不太可能让他感到惊讶。

不,对于来自1750的人来说就像他和我一样有趣,他应该走得更远 - 也许是12 000 BC的一年。 甚至在第一次农业革命之前就允许出现第一批城市和文明概念。 如果来自狩猎采集者世界的人,从人们还是另一种动物物种的时候,看到了1750的巨大人类帝国,他们的高教堂,穿越海洋的船只,他们在建筑物“内部”的概念,一切这种知识 - 他很可能已经死了。

然后,在死后,他会嫉妒并想做同样的事情。 几年前,将在12 000 BC年回归24 000。 呃,会带走一个男人并拖延他的时间。 新旅行者会对他说:“好吧,没关系,谢谢你。” 因为在这种情况下,一名男子来自12 000年BC。 即 一个人必须在几年前回到100 000,并首次向当地原住民展示火灾和语言。

如果我们需要将某人带到未来,以致他对死亡感到惊讶,那么进步必须经过一定的距离。 必须达到致命进步点(TSP)。 也就是说,如果在狩猎采集者TSP占用100 000年的时候,下一站已经在12 000 BC中发生了。 即 在它背后,进步已经更快,并从根本上改变了世界到1750年(大约)。 然后花了几百年,我们在这里。

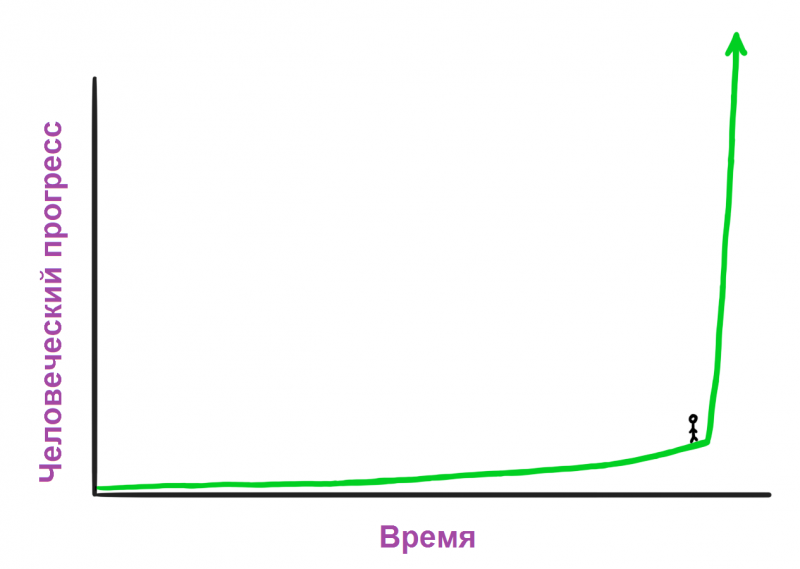

这张照片 - 当人类进步随着时间的推移而变得更快时 - 未来学家Ray Kurzweil将法律称为人类的加速回归 故事。 之所以发生这种情况,是因为更先进的社会有能力以比欠发达社会更快的速度推动进步。 19世纪的人们比15世纪的人们更了解,因此19世纪的进步比15世纪的进步更快并不奇怪,等等。

在较小的规模上,这也有效。 电影“回归未来”在1985年度发行,“过去”在1955年度。 在影片中,迈克尔·J·福克斯一年回到1955时,他对电视的新颖性,苏打水的价格,对吉他声的缺乏热情以及俚语的变化感到吃惊。 当然,这是一个不同的世界,但如果这部电影今天被拍摄,过去是在1985拍摄的,那么差异就会更加全球化。 从个人电脑,互联网,移动电话开始,Marty McFly将会比从1955转到1985的Marty更不合适。

所有这一切都归功于加快回报的规律。 1985和2015年之间的平均进展速度高于从1955到1985年的速度 - 因为在第一种情况下世界更加发达,它在过去30年的成就已经饱和。

因此,成就越多,发生的变化就越快。 但这不应该给我们留下一些未来的暗示吗?

Kurzweil认为整个20世纪的进展可以在20年度的2000年度完成 - 也就是说,在2000中,进展速度是20世纪平均进展速度的五倍。 他还认为,整个20世纪的进展相当于从2000到2014年的进展,而另一个20世纪的进展将相当于今年2021之前的时期 - 即仅仅七年。 几十年后,20世纪的所有进展将每年进行几次,然后 - 仅仅一个月。 最终,加速回报的法则将使我们达到这样的程度:在整个21世纪,1000的进展将是20世纪的进步。

如果Kurzweil和他的支持者是对的,那么2030年会让我们感到惊讶,就像1750家伙会让我们的2015感到惊讶 - 也就是说,下一个TSP只需要几十年 - 而今年的2050世界将与现代的XNUMX世界如此不同会发现。 这不是虚构的。 所以相信许多科学家比你和我更聪明,受教育程度更高。 如果你看一下这个故事,你会明白这个预测是从纯逻辑中得出的。

那么,为什么当我们面对诸如“世界将在35年代变得无法承认”这样的陈述时,我们对我们的肩膀持怀疑态度? 我们怀疑未来的预测有三个原因:

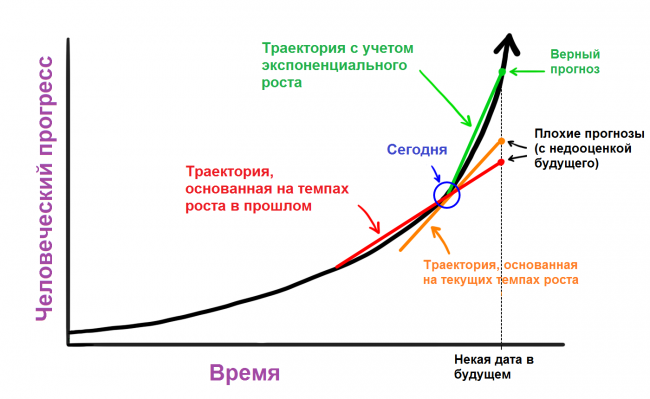

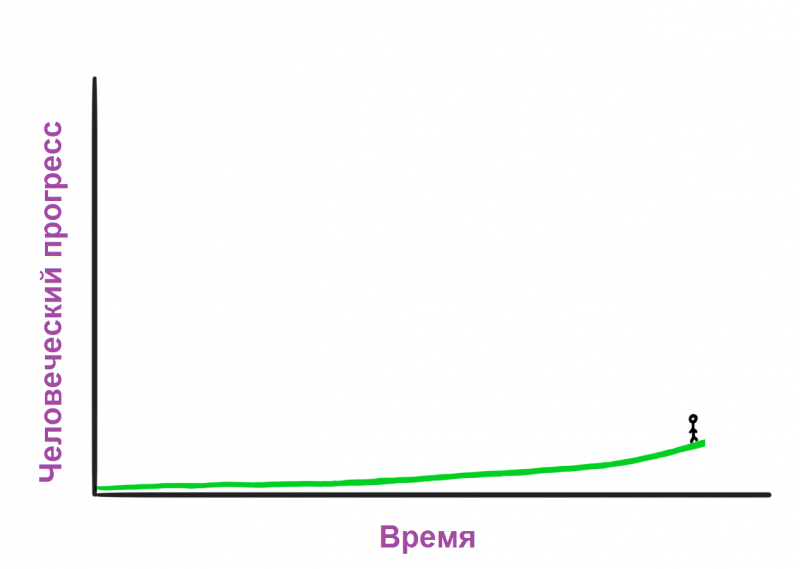

1。 谈到历史,我们以直链思考。 为了展示下一个30年的进展,我们将先前30的进展视为一切可能发生的指标。 当我们思考我们的世界将如何在21世纪发生变化时,我们将迎接20世纪的进步并将其添加到2000年。 同样的错误是我们来自1750的人,当他从1500找到某人并试图让他感到惊讶时。 我们直观地以线性方式思考,尽管我们应该是指数级的。 从本质上讲,未来学家应该尝试预测下一个30年的进展,而不是先前的30,而是根据当前的进展水平来判断。 然后预测将更准确,但仍然超过了大门。 要正确地思考未来,你需要以比现在更快的速度看待事物的运动。

[/ CENTER]

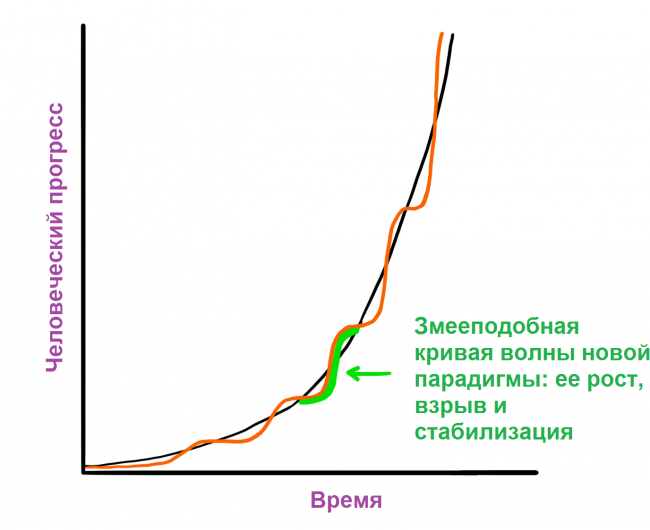

[/ CENTER]2。 近期历史的轨迹往往看起来扭曲。 首先,当你看到它的一小部分时,即使是陡峭的指数曲线也是线性的。 其次,指数增长并不总是平滑和均匀的。 Kurzweil认为,进步正在变成蛇状曲线。

该曲线经历三个阶段:1)缓慢增长(指数增长的早期阶段); 2)快速增长(爆炸性,指数增长的后期阶段); 3)以特定范式的形式稳定。

如果你看一下最后一个故事,你当前所在的S曲线部分可以隐藏你的感知进度。 1995和2007之间的部分时间用于互联网的爆炸性发展,微软,谷歌和Facebook向公众的呈现,社交网络的诞生以及手机的发展,然后是智能手机。 这是我们曲线的第二阶段。 但从2008到2015的时期是一个不那么突破的一年,至少在技术方面。 那些考虑今天未来的人可能需要花费最近几年的时间来评估整体进度,但他们看不出更大的影响。 事实上,新的和强大的2阶段现在可以酿造。

3。 在谈到未来时,我们自己的经历让我们抱怨老人。 我们根据自己的经验建立了关于这个世界的想法,这种经验将我们最近的增长率设定为“理所当然”。 我们的想象力也是有限的,因为它使用我们的经验来预测 - 但更多时候我们根本没有让我们准确预测未来的工具。 当我们听到对未来的预测与我们对事物工作的日常看法不同时,我们本能地认为它们是天真的。 如果我告诉你你将活到150或250年,也许你根本不会死,你会本能地认为“这是愚蠢的,我从历史中知道每个人在这段时间都死了。” 所以它是:没有人活到这么多年。 但直到飞机发明才有飞机飞行。

因此,虽然怀疑主义对你来说似乎是合理的,但它往往是错误的。 我们应该接受,如果我们拥有纯粹的逻辑并且我们正在等待通常的历史曲折,我们必须认识到,在未来几十年中必须非常非常地改变; 比直觉上想象的要多得多。 逻辑还表明,如果地球上最先进的观点继续向前发展,越来越快,在某些时候,跳跃将是如此严重,以至于它将从根本上改变我们所知道的生活。 在进化的过程中发生了类似的事情,当人变得如此聪明以至于他完全改变了地球上任何其他物种的生命。 如果你花一点时间阅读科学和技术现在正在发生的事情,你可能会开始看到关于下一次巨大飞跃将会是什么的某些线索。

超级智能的途径:AI(人工智能)是什么?

像这个星球上的许多人一样,你习惯于认为人工智能是一种科幻小说的愚蠢概念。 但最近,很多认真的人都对这个愚蠢的想法表示担忧。 有什么问题?

导致AI这个术语混淆的原因有三个:

我们将 AI 与电影联系在一起。 “星球大战”。 “终结者”。 “太空漫游 2001”。 但是喜欢 机器人这些电影中的人工智能是虚构的。 因此,好莱坞电影淡化了我们的感知层次,人工智能变得熟悉、熟悉,当然还有邪恶。

这是一个广泛的应用领域。 它首先是手机中的计算器和自动驾驶汽车的开发,并将在未来发展,将彻底改变世界。 AI意味着所有这些事情,而且令人困惑。

我们每天都使用人工智能,但通常我们甚至不会给自己报告。 正如约翰麦卡锡所言,1956中“人工智能”一词的发明者,“一旦他开始工作,没有人称他为AI”。 人工智能已经变得更像是对未来的神话预测,而不是真实的东西。 与此同时,这个标题也体现了过去从未成为现实的东西。 Ray Kurzweil说,他听到人们将人工智能与80的事实联系在一起,可以将其与“互联网在2000开头的网络公司死亡的声明”进行比较。

我们要清楚。 首先,不要再考虑机器人了。 作为AI容器的机器人有时会模仿人体形态,有时它不会,但AI本身就是机器人内部的计算机。 AI是大脑,机器人是身体,如果它有这个身体的话。 例如,Siri软件和数据是人工智能,女人的声音是这个AI的化身,而且这个系统中没有机器人。

其次,你一定听说过“奇点”或“技术奇点”这个词。 这个术语在数学中用于描述普通规则不再有效的异常情况。 在物理学中,它被用来描述黑洞的无限小和密集点或大爆炸的原始点。 同样,物理定律也不适用。 在1993中,Vernor Vinge撰写了一篇着名的文章,他将这个术语应用到未来的时刻,当时我们的技术智能超越了我们自己 - 而在那一刻,我们知道它将永远改变生活,其存在的通常规则将不再起作用。 Ray Kurzweil进一步阐明了这一术语,表明当加速回归定律达到一个极端点时,当技术进步将如此之快以至于我们将停止注意到其成就时,几乎无限快速地实现奇点。 然后我们将生活在一个全新的世界。 然而,许多专家已经停止使用这个术语,所以让我们和我们不会经常提及它。

最后,尽管有许多类型或形式的人工智能源于人工智能的广泛概念,但其主要类别依赖于口径。 主要有三类:

狭义导向(弱)人工智能(AII)。 CII专注于一个领域。 在这样的AI中,有些人可以击败世界象棋冠军,但就是这样。 有一种可以提供在硬盘上存储数据的最佳方法,就是这样。

一般(强)人工智能。 有时也称为人类AI。 AIS被称为智能计算机,就像一个人 - 一台能够执行人类固有的任何智力行为的机器。 创建OII比AII要困难得多,到目前为止我们还没有达到它。 Linda Gottfredson教授将智能描述为“一般意义上的心理潜能,与其他事物一起,包括推理,计划,解决问题,抽象思考,理解复杂思想,快速学习和从经验中学习的能力。” OII应该能够像你一样轻松地做到这一切。

人工超智能(ICI)。 牛津哲学家和人工智能理论家尼克博斯特罗姆将超级智能定义为“智力,它比几乎任何领域中最优秀的人类思维都要聪明,包括科学创造力,一般智慧和社交技能”。 人工超智能包括一个比一个人聪明一点的计算机,以及一个在任何方向都更聪明的计算机。 ISI是人们对人工智能日益增长的兴趣的原因,以及在这种讨论中经常出现“灭绝”和“不朽”的事实。

如今,人们已经在很多方面征服了AI口径的第一步--AII。 AI革命是从AII到IES到CII的路径。 我们可能无法在这条道路上生存,但它肯定会改变一切。

让我们仔细看看这个领域的领导思想家如何看待这条道路以及为什么这场革命可能比你想象的更快地发生。

我们在这个流中的哪个位置?

狭隘的人工智能是机器智能,在执行特定任务时等于或超过人类智能或效率。 一些例子:

*汽车装有AII系统,从确定防抱死制动系统应该工作的计算机到确定燃油喷射系统参数的计算机。 目前正在接受测试的谷歌自动驾驶汽车将包含强大的FID系统,可以感知并响应周围的世界。

*您的手机是一个小型的UII工厂。 当您使用地图应用程序时,获取下载应用程序或音乐的建议,查看明天的天气,与Siri交谈,或者做其他事情,您正在使用PCB。

*您的垃圾邮件过滤器是一种经典的AII类型。 他首先弄清楚如何将垃圾邮件与可用的电子邮件分开,然后学习如何处理您的电子邮件和偏好。

*昨天你在搜索引擎中寻找螺丝刀或新的等离子,这是一种令人尴尬的感觉,今天你在其他网站上看到了有用商店的优惠? 或者在社交网络中,建议您将有趣的人添加为朋友? 所有这些都是FIA系统,它们协同工作,确定您的偏好,通过互联网融合您的信息,与您越来越近。 他们分析了数百万人的行为,并根据这些分析得出结论,以便出售大公司的服务或改善他们的服务。

*谷歌翻译是另一个经典的AII系统,在某些方面表现出色。 语音识别 - 也是。 当你的飞机着陆时,终端不是由人类决定的。 门票价格 - 也是。 今天世界上最好的跳棋,国际象棋,西洋双陆棋,秃头和其他游戏都是高度针对性的人工智能。

*谷歌搜索是一个巨大的AIM,它使用非常聪明的方法对页面进行排名并确定搜索结果的结果。

而这仅限于消费者世界。 复杂的FID系统广泛用于军事,制造和金融行业; 在医疗系统中(记住IBM的Watson)等等。

这种形式的UIA系统不构成威胁。 在最糟糕的情况下,一辆越野车或编程不良的AII可能导致当地灾难,造成停电,导致金融市场脱轨等。 但是,尽管AII没有权力制造存在主义的威胁,但我们必须更广泛地看待事物 - AII预示着一股飓风等待着我们。 AII领域的每项新创新都为通向AIS和CII的道路增添了一个障碍。 或者,正如Aaron Sayents所指出的那样,我们世界的AII类似于“年轻地球主要肉汤的氨基酸” - 而有一天醒来的生命中的非生物成分。

从AII到OII的路径:为什么这么难?

没有什么能够揭示人类智能的复杂性,试图创造一个同样聪明的计算机。 建造摩天大楼,飞向太空,大爆炸的秘密与重复我们自己的大脑或至少只是理解它相比都是胡说八道。 目前,人类大脑是已知宇宙中最复杂的物体。

也许你甚至不怀疑创建一个OII的难度(一个聪明的计算机,就像一个人,一般而言,而不仅仅是在一个领域)。 创建一台可以在瞬间将两个十位数字相乘的计算机比以往更容易。 创造一个可以看到狗和猫的人,并说出狗在哪里以及猫在哪里都是非常困难的。 创建一个可以击败大师的人工智能? 制造 现在试着让他读一本6岁儿童的书中的段落,不仅要理解这些词,还要理解它们的含义。 谷歌正在花费数十亿美元来做这件事。 复杂的事情 - 比如计算,金融市场的计算策略,翻译语言 - 计算机可以轻松应对,但只需简单的事情 - 视觉,动作,感知 - 没有。 正如唐纳德克努特所说,“人工智能现在几乎所有需要”思考“的东西,但无法应对人们和动物不假思索地做的事情。”

当你想到这个的原因时,你会明白在我们看来最简单的事情,只是看起来如此,因为它们在数亿年的进化过程中已经为我们(和动物)进行了优化。 当您将手伸向物体时,肩膀,肘部和手部的肌肉,关节,骨骼会立即执行长链物理操作,这些操作与您所看到的一致并在三维空间中移动您的手。 这对你来说似乎很简单,因为你的大脑的完美软件负责这些过程。 这个简单的技巧允许您为注册一个新帐户制作一个程序,输入一个简单易懂的单词(验证码)和一个恶意机器人的地狱。 对于我们的大脑来说,这并不复杂:你只需要能够看到。

另一方面,大数字的乘法或国际象棋游戏是生物生物的新活动类型,我们没有足够的时间来完善自己(不是数百万年),因此计算机很容易被击败。 试想一下:您是否愿意创建一个可以增加大数字的程序,或者用数百万拼写识别字母B的程序,用最难以预测的字体,用手或者在雪中?

一个简单的例子:当你看到它时,你和你的计算机都明白这些是两种不同色调的交替方块。

但如果你删除黑色,你会立即描述完整的图片:圆柱体,平面,三维角度,但计算机将无法。

他将描述他所看到的不同色调的各种二维形式,原则上这是真实的。 你的大脑正在做大量的工作,解释深度,阴影的播放,图片中的光线。 在图片下方,计算机将看到一个二维的白色 - 灰黑色拼贴画,而实际上有一个三维的石头。

而我们刚刚确定的所有内容,都是与理解和处理信息有关的冰山一角。 为了达到与人相同的水平,计算机必须理解微妙的面部表情的差异,快乐,悲伤,满足,快乐之间的差异,以及为什么Chatsky是好的,而Molchalin - 不是。

怎么办呢?

创建OII的第一步:提高计算能力

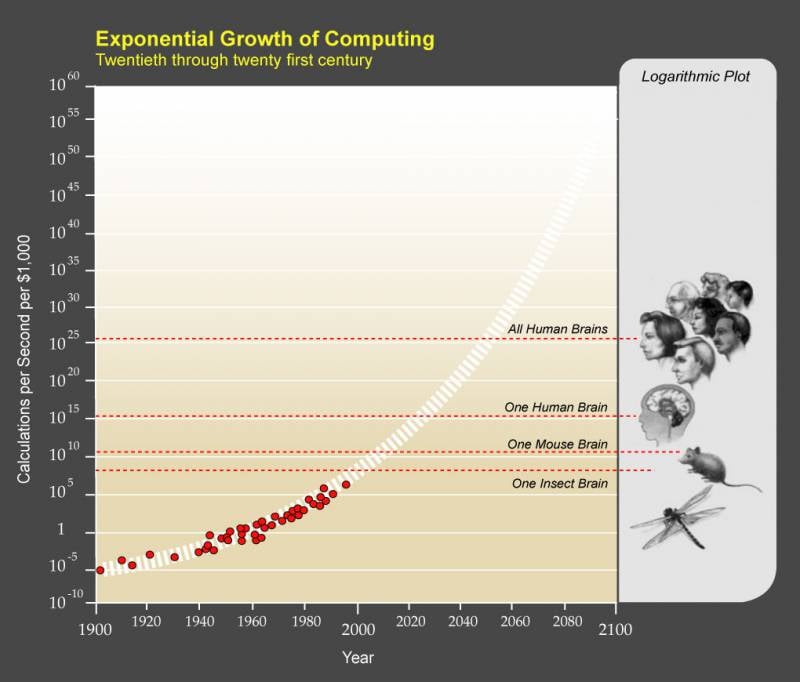

为了使AIS成为可能必须发生的事情之一是增加计算机设备的功率。 如果人工智能系统需要像大脑一样聪明,它需要将大脑与原始计算能力相匹配。

增加这种能力的一种方法是大脑可以产生的每秒计算总数(OPS),你可以通过找出每个大脑结构的最大OPS数量并将它们放在一起来确定这个数字。

Ray Kurzweil得出的结论是,对一个结构的OPS及其相对于整个大脑的重量的重量进行专业评估就足够了,然后按比例增加以获得整体评估。 这听起来有点令人怀疑,但是他做了很多次不同区域的不同估计并且总是得到相同的数字:10 ^ 16或10千万OPS的顺序。

世界上最快的超级计算机,中国天河2,已经绕过了这个数字:它能够每秒执行32千万亿次运算。 但天河-2占用720平方米的空间,吃24兆瓦的能量(我们的脑耗仅为20瓦特),耗资390百万美元。 商业或广泛使用不是问题。

Kurzweil建议我们根据1000美元购买的OPS数来评估计算机的状态。 当这个数字达到人类水平 - 10千万亿OPS - OII很可能成为我们生活的一部分。

摩尔定律 - 一种历史上可靠的规则,它确定计算机的最大计算能力每两年翻一番 - 这意味着计算机技术的发展,如人的历史运动,呈指数级增长。 如果我们将其与成千上万的Kurzweil美元的规则进行比较,我们现在可以为10美元支付1000数万亿的OPS。

计算的指数增长:20-21世纪。 正确的幻灯片规则 - 昆虫,老鼠,男人和所有人的大脑; 在左边,每秒计算1000美元; 年底

1000计算能力的计算机能够绕过小鼠脑,比人类弱一千倍。 这似乎是一个糟糕的指标,直到我们记住计算机比1985中的人类大脑弱十亿倍,1995十亿分之一,2005百万分之一。 通过2025,我们必须得到一台经济实惠的计算机,它的计算能力并不低于我们的大脑。

因此,OII所需的原始电力已经在技术上可用。 在10年内,它将走出中国并传播到世界各地。 但仅靠计算能力是不够的。 接下来的问题是:我们怎样才能为人类的智力提供所有这些力量?

创建OII的第二步:给它一个理由

这部分非常复杂。 说实话,没有人真正知道如何使汽车变得聪明 - 我们仍在试图弄清楚如何创造一个人类级别的头脑,可以区分猫与狗,突出B在雪中绘制,并分析二流电影。 然而,有一些前瞻性思维策略,其中一个很好的时刻应该有效。

1。 重复大脑

这个选项类似于科学家和一个非常聪明且对问题反应良好的孩子坐在同一个班级的事实; 即使他们努力学习理解科学,他们甚至都没有赶上聪明的孩子。 最后,他们决定:地狱,只是写下他的问题的答案。 这是有道理的:我们不能创建一个高度复杂的计算机,所以为什么不把宇宙最好的原型之一作为基础:我们的大脑?

科学界正在努力工作,试图弄清楚我们的大脑如何运作以及进化如何创造出如此复杂的东西。 根据最乐观的估计,他们将仅在2030年度成功。 但只要我们了解大脑的所有秘密,其有效性和力量,我们就可以从其创造技术的方法中获得灵感。 例如,模仿大脑工作的计算机体系结构之一是神经网络。 她从一个由输入和输出相互连接的晶体管“神经元”网络开始,并且不知道任何事情 - 就像新生儿一样。 系统“学习”,尝试执行任务,识别手写文本等。 在正确答案的情况下,晶体管之间的连接得到加强,而在错误答案的情况下,晶体管之间的连接被削弱。 经过多个问题和答案循环后,系统形成了针对特定任务进行优化的智能神经编织。 大脑以类似的方式学习,但是以更复杂的方式学习,并且当我们继续研究它时,我们发现了改善神经网络的新的令人难以置信的方法。

更极端的抄袭涉及一种称为全脑仿真的策略。 目标:将真正的大脑切成薄片,扫描每个大脑,然后使用软件准确地恢复三维模型,然后将其翻译成功能强大的计算机。 然后我们将拥有一台能正式完成大脑所能做的一切的计算机:它只需要学习和收集信息。 如果工程师成功,他们将能够以如此令人难以置信的精确度模拟真实大脑,在下载到计算机后,大脑及其记忆的真实身份将保持不变。 如果大脑在他死前属于Vadim,那么计算机将会以Vadim的角色醒来,Vadim现在将成为人类的OII,反过来,我们将把Vadim变成一个非常聪明的ICI,他一定会对此感到高兴。

我们距离完整的大脑仿真有多远? 事实上,我们只是模拟了一个包含302神经元的毫米扁虫的大脑。 人脑包含100数十亿个神经元。 如果试图获得这个数字对你来说似乎毫无用处,那么请记住进步的指数增长率。 下一步将是模仿蚂蚁的大脑,然后会有一只老鼠,然后就会有一颗石头向人扔石头。

2。 试着追随进化的脚步。

好吧,如果我们认为一个聪明的孩子的答案太复杂而无法注销,我们可以尝试遵循其培训和考试准备的脚步。 我们知道什么? 建立一个像大脑一样强大的计算机是很有可能的 - 我们自己大脑的进化证明了这一点。 如果大脑太复杂而无法模仿,我们可以尝试模仿进化。 事实是,即使我们可以模仿大脑,它也可以像是通过荒谬的挥动手来重建鸟类的翅膀来制造飞机。 大多数情况下,我们设法使用面向机器的方法创建好的机器,而不是精确模仿生物学。

如何模拟进化以建立OII? 这种称为“遗传算法”的方法应该是这样的:必须有一个生产过程及其评估,这将一次又一次地重复(就像生物存在“存在”和“通过它们的繁殖能力来评估”)。 一组计算机将执行任务,其中最成功的将与其他计算机“输出”共享其特征。 不太成功将被无情地扔进历史的垃圾箱。 经过多次迭代,这个自然选择过程将带来最好的计算机。 困难在于推导和评估周期的创建和自动化,因此演化过程是独立的。

复制进化的缺点是进化需要数十亿年的时间来做某事,而我们只需要几十年的时间就可以做到。

但与进化不同,我们有很多优势。 首先,它没有远见的礼物,它是偶然的 - 它会产生无用的突变,例如,我们可以在任务集的框架内控制过程。 其次,进化没有目标,包括追求智力 - 有时候在环境中,某些收益不会以牺牲智力为代价(因为后者会消耗更多能量)。 另一方面,我们的目标是增加智力。 第三,为了选择智能,进化需要进行一些第三方改进 - 比如通过细胞重新分配能量消耗 - 我们可以简单地去除多余的电力并使用电力。 毫无疑问,我们将比进化更快 - 但同样,我们是否能超越它还不清楚。

3。 为自己提供电脑

这是科学家完全绝望并尝试编制自我发展计划的最后机会。 但是,这种方法可能是最有希望的。 我们的想法是创建一台具有两项主要技能的计算机:探索人工智能和代码更改本身 - 这不仅可以让他们了解更多,而且还可以改进自己的架构。 我们可以将计算机培训成计算机工程师,使他们自己发展。 他们的主要任务是弄清楚如何变得更聪明。 我们稍后会详细讨论这个问题。

所有这一切都很快就会发生。

硬件和软件实验的快速发展并行运行,AIS可以快速出乎意料地出现,主要有两个原因:

1。 指数增长是密集的,似乎蜗牛的步骤可以迅速变成跨越式 - 这个gif很好地说明了这个概念:

动画:hi-news.ru/wp-content/uploads/2015/02/gif.gif

计算机何时会超越人类智慧? 密歇根湖的体积(以盎司的流量计)等于我们大脑的体积(每秒操作次数)。 计算能力每18个月翻一番。 按照这种速度,你很长时间都不会看到任何结果,但一切都会立即发生。

2。 谈到软件,进展可能看起来很慢,但是一个突破会立即改变前进的速度(一个很好的例子:在地心世界感知的时代,人们很难计算宇宙的工作,但是日心说的发现使一切变得更加简单)。 或者,当涉及到改进自身的计算机时,一切看起来都非常缓慢,但有时系统中只有一个修正案将其与人或先前版本的千倍效率区分开来。

从OII到ICI的道路

在某一点上,我们肯定会获得OII - 一般人工智能,具有一般人类智能水平的计算机。 计算机和人们将共同生活。 或者不会。

事实上,具有与人相同水平的智力和计算能力的OII仍将具有超越人的显着优势。 例如:

Оборудование

速度。 脑神经元以200 Hz的频率工作,而现代微处理器(比我们在创建OII时获得的速度慢得多)以2 GHz的频率工作,或10比我们的神经元快数百万倍。 并且可以以120 m / s的速度移动的大脑的内部通信明显不如计算机使用光学器件和光速的能力。

尺寸和存储。 大脑的大小受到头骨大小的限制,并且不能变大,否则120速度的内部通信需要很长时间才能从一个结构移动到另一个结构。 计算机可以扩展到任何物理尺寸,使用更多设备,增加RAM,长期记忆 - 这一切都超出了我们的能力。

可靠性和耐用性。 不仅计算机内存更人性化。 计算机晶体管比生物神经元更精确,并且不易变质(并且通常可以更换或修复)。 人们的大脑变得更快,电脑可以不停地工作,每天24小时,每周7天。

Программноеобеспечение

具有编辑,升级和更广泛可能性的能力。 与人脑不同,计算机程序可以很容易地修复,更新,用它进行实验。 现代化也可能受制于人脑弱的领域。 负责视觉的人的软件安排得非常好,但从工程的角度来看,他的能力仍然非常有限 - 我们只看到可见光谱。

集体能力。 人们在大集体思想方面优于其他物种。 从语言的发展和大型社区的形成开始,通过写作和印刷的发明,现在通过使用互联网等工具激活,人们的集体思想是我们放大进化王冠的重要原因。 但是电脑仍然会更好。 全球人工智能网络,在一个程序上工作,不断同步和自我开发,无论您在何处获得,都可以立即向数据库添加新信息。 这样一个小组也将能够在一个目标上工作,因为计算机不会像人一样受到特殊意见,动机和个人兴趣的影响。

人工智能最有可能通过程序化的自我改进成为OII,它不会将“人类智慧”看作一个重要的里程碑 - 这个里程碑对我们来说只是重要的。 他没有理由停下这个可疑的水平。 而且鉴于即使是人类级别的OII所具有的优势,很明显,人类智能将在他的智力竞赛中为他提供短暂的优势。

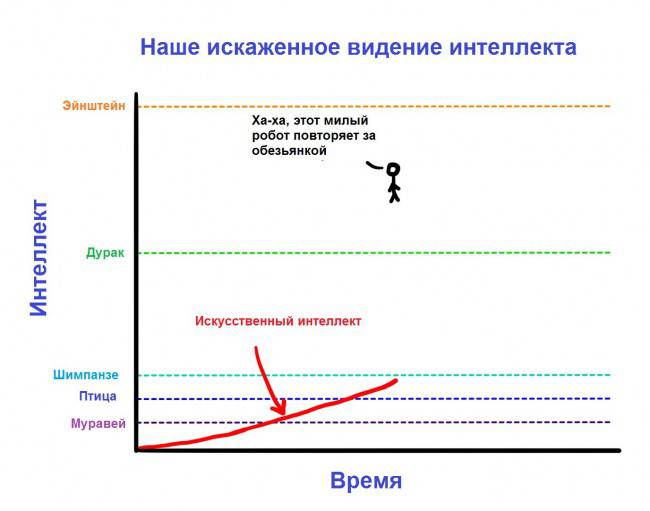

这种发展可能会让我们非常非常惊讶。 事实是,从我们的观点来看,a)允许我们确定智力质量的唯一标准是动物智能,默认情况下低于我们的智力; b)对我们来说,最聪明的人总是比最愚蠢的人聪明。 像这样:

也就是说,虽然人工智能只是试图达到我们的发展水平,但我们看到它变得更聪明,接近动物的水平。 当他达到第一个人类水平 - 尼克博斯特罗姆使用“乡村白痴”一词时 - 我们会很高兴:“哇,他已经像个白痴。 很酷!“ 唯一的事情是,在人们的智慧的一般范围内,从村里的白痴到爱因斯坦,范围很小 - 所以在AI达到傻瓜的水平并成为OII之后,他会突然变得比爱因斯坦聪明。

接下来会发生什么?

爆炸的情报

我希望你觉得它有趣而有趣,因为从这一点来说,我们讨论的主题变得异常和令人毛骨悚然。 我们应该暂停并提醒自己,上面提到的每一个事实都是对最杰出的思想家和科学家所表达的未来的真实科学和真实预测。 请记住。

因此,正如我们上面指出的那样,我们所有关于OII成就的现代模型都包含了AI改进自身的选项。 一旦他成为一个OII,即使他长大的系统和方法也变得足够智能,如果他们愿意的话,可以自我提升。 一个有趣的概念出现了:递归的自我改进。 它的工作原理如下。

某个特定级别的人工智能系统 - 例如一个村民白痴 - 被编程以改善其自身的智能。 已经发展 - 比如爱因斯坦的水平 - 这种系统开始随着爱因斯坦的智慧发展,它需要更少的时间来发展,而且飞跃更大。 它们允许系统超越任何人,变得越来越多。 随着它的快速发展,OII在其知识分子中飙升到天堂般的高度,并成为ISI的超级系统。 这个过程被称为智力爆炸,这是加速回归定律的最明显的例子。

科学家们争论AI如何快速达到OII的水平 - 大多数人认为OII我们将在2040年度进入25年,这在技术发展标准上非常非常少。 继续逻辑链,很容易假设从OII到IIS的过渡也将非常迅速地发生。 像这样:

“在第一个人工智能系统达到最低智能水平之前需要几十年的时间,但它终于发生了。 计算机能够像四岁男一样了解周围的世界。 突然间,在达到这个里程碑的一个小时后,该系统产生了一个伟大的物理理论,它结合了广义相对论和量子力学,这是任何人都无法做到的。 一个半小时后,AI成为ICI,170 000比任何人都聪明。“

为了表征这种程度的超级智能,我们甚至没有合适的术语。 在我们的世界中,“聪明”意味着拥有IQ 130的人,“愚蠢” - 85,但我们没有IQ 12 952人的例子。 我们的统治者不是为此而设计的。

人类的历史清楚而明确地告诉我们:与智慧,力量和力量一起出现。 这意味着当我们创造一个人造的超级智能时,它将成为地球上生命历史上最强大的生物,所有生物,包括人类,都将完全掌握在他的力量中 - 这可能在二十年后发生。

如果我们微薄的大脑能够提出Wi-Fi,那么比我们更聪明的东西能够轻松地计算出宇宙中每个原子在任何特定时间的位置。 所有这些都可以被称为魔法,任何归于无所不能的神的力量都将由ISI支配。 创造一种技术来逆转衰老,治愈任何疾病,摆脱饥饿甚至死亡,管理天气 - 突然变得可能。 地球上所有生命的直接结束也是可能的。 我们这个星球上最聪明的人都同意,一旦人类超级智能出现在世界上,这将标志着上帝在地球上的出现。 而重要的问题仍然存在。

他会成为一个好神吗?

基于waitbutwhy.com,由Tim Urban编写。 本文借鉴了尼克·博斯特罗姆,詹姆斯·巴瑞特,光芒Kurzweil,周杰伦尼尔斯 - 尼尔森,史蒂芬·平克,弗诺·文奇,摩西·瓦迪,拉斯·罗伯茨,斯图尔特Armstroga和凯细胞,苏珊·施耐德,斯图尔特罗素和彼得·诺维格,西奥多·莫迪塞,加里工作Marcus,Carl Schulman,John Searle,Jaron Lanier,Bill Joy,Kevin Keli,Paul Allen,Stephen Hawking,Kurt Andersen,Mitch Kapor,Ben Herzel,Arthur Clarke,Hubert Dreyfus,Ted Greenwald,Jeremy Howard。

- ILYA HEL

- //hi-news.ru/research-development/iskusstvennyj-intellekt-chast-pervaya-put-k-sverxintellektu.html

信息