Deadborn 的想法:联合国计划禁止军事人工智能

第一次警告

正如你所知,未来不是预先确定的,但许多人想尝试影响它。 第六次会议将于 13 月 17 日至 1980 日在日内瓦举行,以审查《常规武器公约》的工作。 回想一下,公约的制度起源于 XNUMX 年,旨在限制某些物种的传播 武器造成过度伤害。 总共签署了五项议定书,禁止不可医学检测的弹片和弹药碎片、诱杀装置、燃烧武器、致盲激光、集束炸弹和非自毁弹药。 世界上大多数国家都签署了这个公约,只有很小的保留。 和世界政治一样,签约并不意味着充实。 所以在这种情况下,有签署和批准的国家,也有刚刚签署的国家。 在后一种情况下,该国不承担任何特殊义务。 此外,并非所有协议都可以签署,因此在任何情况下都可以自由操作。 顺便说一下,俄罗斯已经签署并批准了该公约的所有五项议定书。

有可能在不久的将来,军用人工智能也将被添加到这份禁用常规武器清单中。 然而,联合国律师的逻辑有很多奇怪之处。 该公约建议,如果武器造成过度痛苦或只是滥杀滥伤,则应禁止使用这些武器。 至少现在,人工智能的目的是降低战争的残酷程度。 一个说明性的例子是伊朗核物理学家 Mohsen Fakhrizadeh 被谋杀,摩萨德从安装在机器人平台上的 7,62-mm FN MAG 机枪中淘汰了他。 据消息人士透露,车内装有大量人工智能——设备独立跟踪受害者并指向机枪。 实际上,由于操作员命令和执行器之间有 1,6 秒的延迟,因此这是不可能的。 结果,在收到以色列的“批准”后,机器人实际上自己射击了法赫里扎德。 在这种情况下,人工智能 (AI) 的作用不仅仅是人道——最终,以色列人可以简单地用导弹摧毁整个地区,连同目标一起摧毁许多不必要的人。

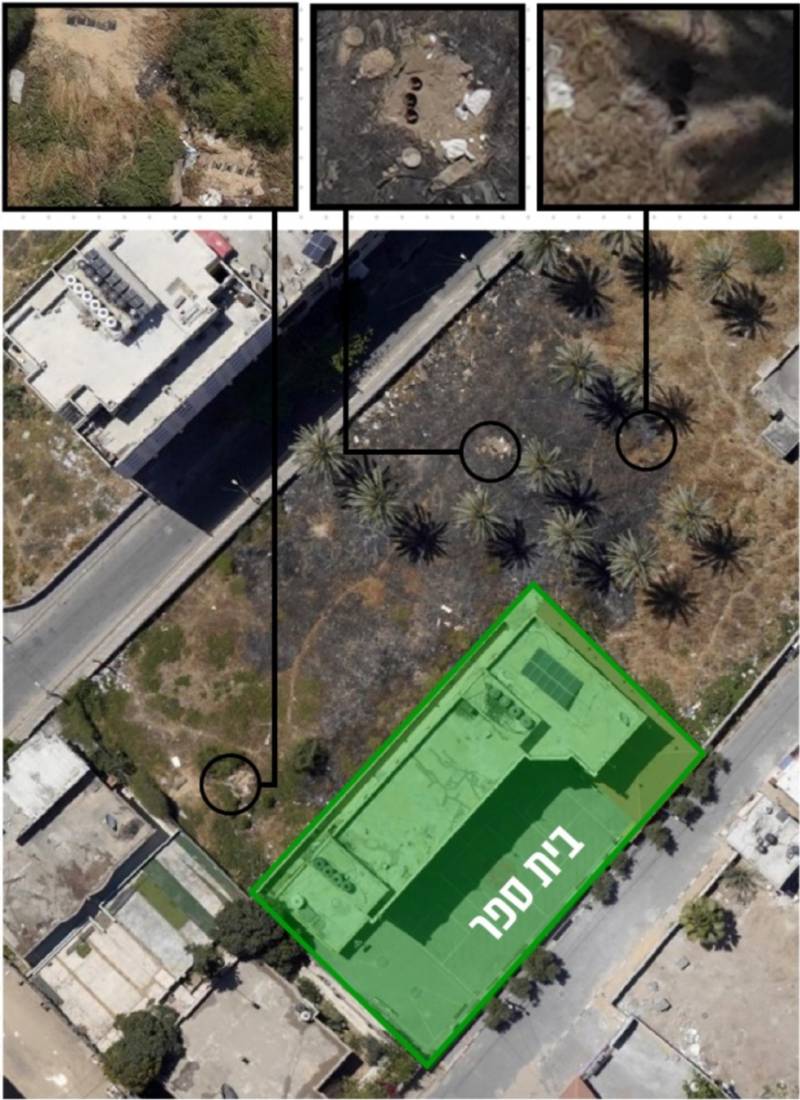

UNPO公约修正案的发起者提议只保留遥控武器,并禁止独立决定摧毁一个人或其他目标的设备。 然而,人工智能不仅可以用于破坏,还可以用于侦察。 例如,在最近与巴勒斯坦人的冲突期间,以色列人使用一群四轴飞行器组织了对导弹发射器的搜索和监视。 无人机在自主模式下进行大面积梳理,寻找恐怖分子并将攻击机瞄准他们。 人工智能甚至能够破译普通学校院子里的地下哈马斯导弹发射器。 在为期 30 天的战争中,总共派出了成群的无人机进行侦察至少 XNUMX 次。 以色列情报部门自豪地将此案称为世界上第一场人工智能战争。 在这种情况下,我们再次谈论节省弹药的点效应,更重要的是,节省非战斗人员的生命。 限制此类功能以对抗人工智能是否有意义?

同时,一群无人机所蕴含的技术情报可以迅速从侦察技术转变为冲击技术。 美国人计算出,800 架由情报联合起来的武装直升机比 1000 架独立的直升机执行效率高得多。 故事 去年 2 月,在利比亚战争期间独立追踪并摧毁了叛乱分子的土耳其无人机 Kargu-XNUMX 也表明尽早禁止这种“智能”武器。 当一个人杀死一个人时,这是一回事,但当一块铁自己做出决定时,又是另一回事。 公平地说,这个故事并不完全清楚——无人机的自主程度并不完全清楚。 这可能是另一个土耳其广告。

最后,军事人工智能反对者的主要论点是技术正在迅速变得更便宜,并且在世界范围内迅速传播。 这种不对称的威胁已经在叙利亚、乌克兰、也门以及所有恐怖组织可以使用速卖通服务的国家成为现实。 更准确地说,它不一定是恐怖分子——在墨西哥,贩毒集团沉迷于无人机。 然而,它甚至闻起来都不像人工智能的雏形。

第六议定书

在世界政治中,习惯上在重大事件发生之前仔细准备场地。 因此,在日内瓦会议前夕,网络上出现了一段病毒视频,旨在提高公众对无人机大军危险的看法。 来自未来生命研究所(有一个)的作者在相当高的水平上拍摄了一段视频,他们在其中模拟了未来。 它是凄凉的,我必须说。 恐怖分子四轴飞行器进行大规模恐吓行为,从天上袭击和平的人,用机枪射击。 在其中一个框架上 机器人- 与美国最近推出的狙击四足狙击无人机“远景60”惊人相似的狗正在向行政大楼开火。 一个没有准备的观众通常可以从表面上理解屏幕上发生的事情,而一个有准备的观众至少会被视频的想法所感染。 该视频已经获得了超过5万的点击量,这可能会对日内瓦的决策中心产生一定的影响。

但如果我们想象第六项议定书会出现在常规武器公约中,军事人工智能会被禁止吗? 首先,积极开发相关技术的国家——美国和中国,不会签署。 顺便说一下,俄罗斯对计划中的限制也不满意。 如果主力球员不签约,那么其他人就没有理由加入。 谁愿意主动限制自己,将手掌传给对手,甚至是潜在的对手? 除非第三世界国家会示范性地签署新协议并引以为豪。 只是现在他们没有人工智能,他们永远不会。 此外,人工智能拥有者的前景将是无穷无尽的,这将成为禁令程序的重要障碍。 与已经被禁止的致盲激光和燃烧武器相比,能够在没有人为干预的情况下选择性地消灭敌人而无需麻烦和担忧。 同时,专家表示,此类人工智能系统不受控制的攻击风险较低。 机器大脑没有动机去破坏它。 没有人反对自动驾驶汽车,对吧? 我们记得,他们已经杀死了比军事人工智能更多的人。 既然存在恐怖分子拦截军用无人机的危险,那为什么没有人担心未来拦截控制和平四轮无人机呢? 某些“特斯拉”的自动驾驶仪可以“发疯”,飞向人群,安排事故,其锂离子电池起火。 一般来说,在和平生活中,可能来自人工智能,问题不亚于军事道路。

最后,禁止自主杀手的主要内容——谁来追踪和控制? 需要一个拥有极其广泛权力的独立组织。 将自主无人机与遥控无人机区分开来在技术上具有挑战性,并且显然会被潜在的第六协议的违反者利用。 试图将人工智能纳入常规常规武器现在看起来像是一个胎死腹中的想法。

信息