第三次军事革命:不应装备机器智能

二十一世纪的主要趋势

尽管“人工智能”(以下简称AI)一词含混不清,但长期以来,创造了在世界上众多军队中出现高生产力和自学式战斗系统的所有先决条件。

如果不存在人工智能,它仍然必须被发明。 现在,几乎在人类生活的所有领域,每秒都会产生大量信息,而这些信息根本就不需要处理。

军事事务绝非例外-回顾纳戈尔诺-卡拉巴赫的冲突足以了解军事行动信息饱和的真实规模就足够了。

照片,视频和雷达数据流以及音频和文本消息流已成为该领域的主流。 只有现在我们才能改写著名的表达

“谁拥有信息谁拥有世界”

进入现代

“谁能快速分析信息拥有的世界。”

对于“大数据”(或大数据)的操作处理,需要非常严格的技术。 例如能够在无需操作员干预的情况下进行自学习的人工神经网络。 神经网络的一个重要优点是能够根据原始训练代码中不存在的数据识别模式。

对于军方而言,人工智能处理不完整,“嘈杂”或失真的数据的潜在能力尤为重要。 这就是为什么深度学习神经网络正在等待视图智能系统快速分析视频和摄影材料的原因。 正如军事部门所指出的那样,人工智能可以在几秒钟内解决数十个解码器花费数月的工作。

但是,即使是现在,对数据集进行简单分析似乎仍不足以用于军事行动-这需要

“预测可能的动作”

и

“预测响应”

潜在目标。

根据这些“结论”,操作员将决定开火。 这将严重加速进攻行动的进程。

例如,几年前,在“持久自由行动”中,MQ-1“捕食者”无人机进入了敌方设备护卫队。 但是,当操作员正在评估从属关系并决定发射火箭时,设备离开了受影响的区域。 这远非唯一的例子。

在这种情况下,使用AI可以快速预测罢工的前景和时机。 但是这里也有陷阱。

红十字会委员会对将人工智能引入无人驾驶汽车以及(最重要的)人类对其信任的程度表示严重关注。 例如,仅基于神经网络的视频信号分析,是否可以可靠地将在道路附近挖掘的人识别为简易爆炸装置操作员?

现在鼓手 无人机 很多时候没有意识到战场上发生的事情的真实性(Playstation 心态)。 如果人工智能帮助他们呢?

已经明显简化的销毁任务将变得更易于执行。

自动化!

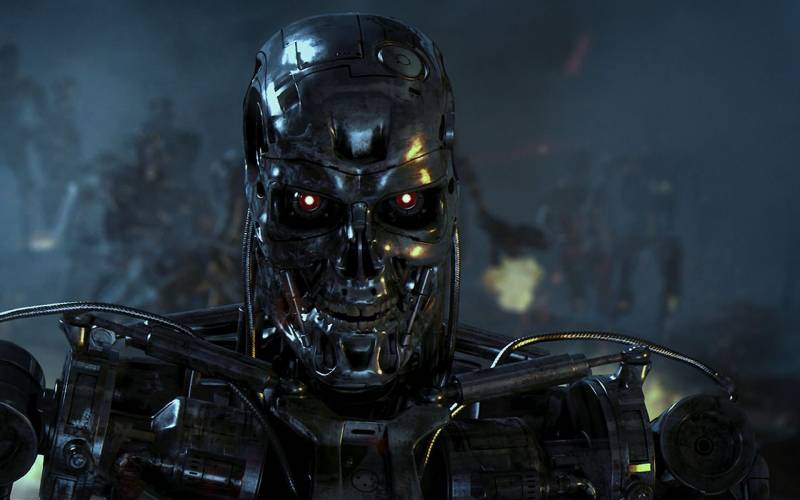

技术和战略挑战迫使世界大国逐渐将其军队转移到机器人技术的轨道上。

例如,在美国,“第三次补偿战略”承诺将武装部队变成军队。 机器人 已经三十年过去了。 十年后,五角大楼每三架飞机中就有一架是无人驾驶的。

俄罗斯也在努力跟上。 他们计划在未来几年中将数十种新型遥控武器投入军队。 但是,美国和俄罗斯都仍然缺乏成熟的由AI控制的侦察和打击系统。 这主要是由于责任危机。 如果仍然可以忍受第一类错误,即错误地消除了对敌人的打击,那么第二类错误将使一切变得更加复杂。 在后一种情况下,车辆要么决定“友善开火”,要么摧毁平民,即犯了战争罪。

在这种情况下,尚不清楚是谁负责这种行为,是软件开发人员还是命令使用该系统的指挥官。

在汽车工业中也存在类似的情况,几十年来一直梦想着完全自动驾驶的无人机。 甚至还制定了自动化级别的分类,这非常适用于军事领域。

在零水平时,汽车是有条件的UAZ-496,其中一切都在驾驶员的控制之下,并且没有机电助力器-ESP,ABS等。

在最高的第五级,轮式无人机甚至没有方向盘(或作为付费选件安装)。 并且在所有情况下,机芯均由自动驾驶仪控制。 目前,只有日本本田能够认证XNUMX级串行自动驾驶仪。

这种“有条件的自动化”技术无法在危险情况下接管控制。 在正常情况下,它并不总是有效。 交通堵塞驾驶员系统会自动将车辆驾驶在交通堵塞中,将其保持在高速公路的车道内并进行超车。 您可以将手从方向盘上移开,但不能将视线移开道路-相机在注视着。 第三级自动驾驶仪非常昂贵,并且使汽车的总成本增加了一半半。

应当记住,自动驾驶仪已经可以在批量生产中完全实现。 他们将真正减少道路交通事故的发生。 但是,由于人工智能的错误(包括致命错误)造成的法律和道德问题使汽车公司陷入了停滞。

AI不应该武装

在军事领域,完全自主的战斗系统的发展情况也远非理想。

这甚至不是问题的技术方面。

一方面,持怀疑态度的专家指出了基于神经网络的自我学习系统提供先发制人打击的潜在能力。 例如,人工智能将在敌人身上看到真实或可察觉的脆弱性-为什么这不是进行第一次解除武装打击的理由? 除此之外,所有“人工大脑”都容易竞争,缺乏批判性思维的要素,这也不会增加人的信心。

总体而言,兰德公司(RAND Corporation)的分析人员在任何情况下都不应敦促现在或将来都将军事战略决策信任人工智能。 尽管仍然有可能与被AI误杀的数名非战斗人员和解,但如果将其应用于核威慑力量,一切将更加悲惨。

操作战术并非一切都那么简单 武器 AI控制。

让我们回到纳戈尔诺-卡拉巴赫(Nagorno-Karabakh)的录像中,该录像清楚地说明了冲击无人机相对于传统武器的技术优势。 在这里,每个人都知道,虽然非常完美,但天空中只有遥控机器。

如果罢工是由完全自主的Bayraktar发起的,公众的反应是什么?

尽管手握武器,什么时候AI可以活到全世界杀人?

问题的道德方面尚未在这里解决。 而且在不久的将来不太可能解决。

资料来源:mil.ru

一般来说,军队中的机器人当然是不错的。

它们使您可以从敌人的直接火力中撤出士兵,将所有工作转移到远程控制的战斗部队。 减少损失和成本。 战争似乎变得更加人道了。

军事领域的完全自主机器人或“致命自主武器系统”与人性和减少损失根本不相关。 深度学习神经网络使战争更加迅速和昂贵。 实际上,这正是前两次军事变革中的火药和核革命所确保的。

许多参与国家国防项目的民营公司都知道这一点。

于是,2018年,谷歌退出了价值超过7,5亿美元的高利润Maven项目。 来自硅谷的专家与 DARPA 合作开发了一个程序,用于处理来自众多情报机构的视频和照片信息阵列 无人驾驶飞机. 数据由神经网络处理。 并按照销毁的优先顺序为操作员提供了“目标库”。 谷歌出 故事... 现在,DARPA正在尝试独自应对。

人工智能在军队中的一个重要方面是其在信息战中的使用。

我们可以肯定地说,在不久的将来,俄罗斯和(在更大程度上)中国在发展打击人工智能方面的更多启示只会从美国倾泻而出。 如果不能说服国内公众需要自主的军事思想,那么我们将受到外部敌人的恐惧。 五角大楼自古以来就以这种逻辑而闻名。 他们说他们已经在全力致力于AI了,在这里我们无法应付自己的道德。

最后,对作战AI威胁的不对称反应看起来很有希望。 如今,从全能的人工智能眼中掩盖对象甚至故意欺骗的技术正在获得发展。

到目前为止,当信息在银盘上传送时,AI在和平的条件下可以很好地工作。

使用不完整且嘈杂的数据非常困难。 因此,用故意纠正的数据误导机器智能的尝试看起来很合逻辑。 当武装AI的响应时间以秒为单位计算并且不依赖于人的意见时,这种错误信息可能会导致难以预测的后果。

最好以友好的方式取消第三次军事革命。

或制定联合限制措施,以在军事领域发展和使用人工智能。 您是否可以在核武器方面做类似的事情?

信息