坦克骚动。 五角大楼打算为装甲车配备人工智能

矛盾的ATLAS

去年年初,美国军方震惊了世界 新闻 关于ATLAS(高级目标和致命性辅助系统)系统的开发,该系统旨在将作战行动提高到新的自动化水平。 这项倡议在普通百姓和开明的军事专家中引起了不同的反应。 大多数责任归咎于开发商(军事C5ISR中心和国防部的武器中心),为使他们回音ATLAS,他们在名称中包括了“致命性”和“改进的目标指定”两个术语。 害怕 故事 关于叛军 机器人,美国人批评军队的承诺,他们说,这违背了战争的道德。 特别是,许多人提到了五角大楼指令 3000.09,该指令禁止将开火权转移给自动化系统。 据抗议者称,将人工智能和机器学习融入地面技术可能会导致平民和友军伤亡惨重。 批评者中有相当受人尊敬的科学家——例如,加州大学伯克利分校计算机科学教授斯图尔特·罗素 (Stuart Russell)。

开发人员相当合理地解释说,ATLAS与人类自第一个“终结者”以来就一直梦想的假想“杀手机器人”无关。 该系统基于使用各种传感器系统的目标搜索算法,选择最重要的传感器并向操作员告知有关信息。 现在在美国,带有集成式ATLAS系统的M113装甲运兵车正在接受测试。 对于武器的操作员而言,人工智能算法不仅可以在屏幕上显示最危险的目标,而且还可以推荐弹药的类型,甚至可以推荐击发次数,以确保战败。 根据开发人员的说法,射手的最终决定权仍由射手决定,由射手负责结果。 装甲版ATLAS的主要任务是提高对潜在威胁的反应速度-平均而言,坦克(BMP或装甲运兵车)使用自动助手以三倍的速度向目标开火。 自然,装甲车可以更有效地与目标群协同工作。 在这种情况下,人工智能会按照坦克危险的顺序迅速选择目标,自行引导武器并推荐弹药类型。 自XNUMX月初以来,具有集成ATLAS系统的各种装甲车已在阿伯丁试验场进行了测试。 根据工作结果,将决定进行军事测试,甚至通过类似的决定。 武器.

在香港仔试验场测试ATLAS组件。 图为着陆舱M113。 资料来源:c4isrnet.com

坦克现在是战场上最保守的对象之一。 很多都几十年没有根本的进步,技术发展还停留在上世纪70-80年代。 这种惰性通常与个别国家广泛使用坦克有关。 为了使成千上万的装甲部队真正现代化,需要大量资源。 但是对抗坦克的手段正在突飞猛进地发展。 一个很好的例子是当前在纳戈尔诺-卡拉巴赫发生的冲突,当时土耳其和以色列 无人驾驶飞机 对亚美尼亚坦克极为有效。 如果忽略生命损失,这样的反坦克武器的性价比计算,简直就是战场上的王者。 当然,ATLAS 不会抵御来自空中的威胁,但它可以成为对坦克威胁目标(例如 ATGM 机组人员或单榴弹发射器)进行预警的好工具。

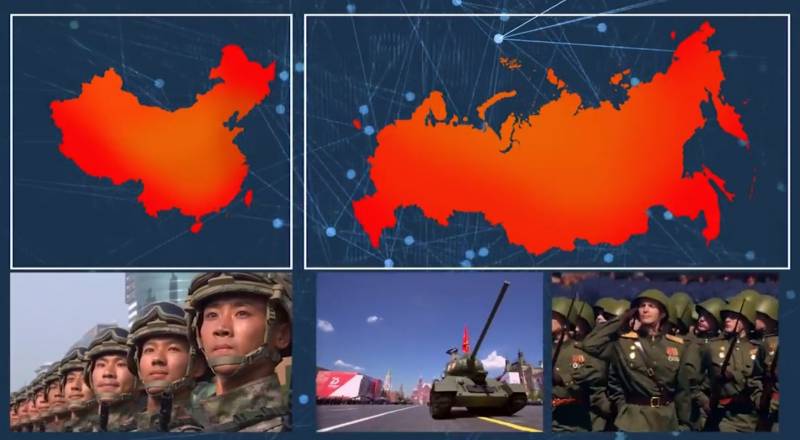

五角大楼认为ATLAS系统不是单一的军事结构,而是大型项目融合的一部分。 这项举措应使部队意识进一步提高。 通过机器学习,人工智能以及无人机在战场上空前的饱和,美国人希望能够认真提高其部队的作战能力。 关键思想并不新鲜-将战场上的所有物体与共同的信息结构连接起来并数字化周围的现实。 到目前为止,由于缺乏与“邻居”的数据交换技能,ATLAS尚未完全包含在Project Convergence中,但是在将来,坦克的人工大脑将成为一种共有财产。 顺便说一下,在该项目的商业广告中,中国和俄罗斯被指定为明确的军事目标。

对电子产品不信任

美军已经对武装机器人系统产生了负面印象。 2007年,三个装有M249机枪的小型履带平台SWORDS(“特种武器观察侦察侦察系统”的缩写)被派往伊拉克。 尽管它们不是完全自动驾驶的车辆,但他们设法在巡逻巴格达的街道时,周期性地乱动机枪枪管,吓scar士兵。 在五角大楼看来,这似乎是不可预测的迹象,被追踪的机枪手被慢慢送回家。 2012年发布了一项指令,指出自动和远程控制的武器系统不应自行射击。 正式而言,ATLAS的开发完全在此条款的框架内进行,但是关于创新的问题不少。 一些专家(特别是宾夕法尼亚大学政治学助理教授迈克尔·霍洛维茨(Michael S. Horowitz))指责过分简化实现目标的过程的新颖性。 实际上,这种搜索和目标指定的自动化水平将战斗变成了枪手世界之类的普通游戏。 在ATLAS制导系统中,优先目标以红色突出显示,警报声响起,并且该技术会尽可能激发人开火。 在极端的战斗条件下,几乎没有时间来决定射击,然后还有一个“智能机器人”的鼓励。 结果,战斗机根本没有时间认真评估情况,并且在不了解情况的情况下开枪射击。 有必要评估拍摄后ATLAS如何正确选择目标。 这种方法在多大程度上符合道德规范,并且符合臭名昭著的美国指令? 顺便说一句,微软已经设法受到公众的谴责,因为这种头盔式目标指定系统可用于军方,甚至包括抵制用户。 在美国,关于机器人检测和制导系统的争论已经很多年了。 举个例子,批评家举了一些例子,说明在公共道路上自动驾驶仪系统的错误,这些错误已经导致人员伤亡。 如果即使在行驶了数百万公里之后,自动驾驶仪也没有变得100%可靠,那么我们可以说完全新鲜的ATLAS,它可以推动油轮向120 mm弹丸的无辜人员射击。 现代战争之所以如此流血,正是因为军方有机会远程杀人,躲在可靠的屏障后面。 提到的纳戈尔诺-卡拉巴赫的例子再次证实了这一事实。 如果战斗人员也失去了严格评估目标参数的机会(这正是ATLAS的目标),那么受害者可能会更多,谋杀的责任已经部分转移到了机器上。

最后,在和平主义者中,反对ATLAS型系统的主要论点是实际上没有禁止自动射击的禁令。 现在,只有五角大楼的道德要求(也有很多保留)禁止完全自动化谋杀过程。 随着ATLAS的推出,这将完全没有技术障碍。 美军是否能够放弃这样一个有前途的机会,以进一步加快对威胁的响应时间,并使其士兵免受攻击?

信息